Tarefas, modelos, artefatos e conjuntos de dados de ML

Rastreamento e visualização de métricas

Acompanhamento de custos e desempenho

Ao se concentrar em tarefas, modelos, artefatos e conjuntos de dados de ML, as organizações podem garantir monitoramento, registro e gerenciamento de fluxos de trabalho de ML.

Com o OptScale, os usuários obtêm total transparência em:

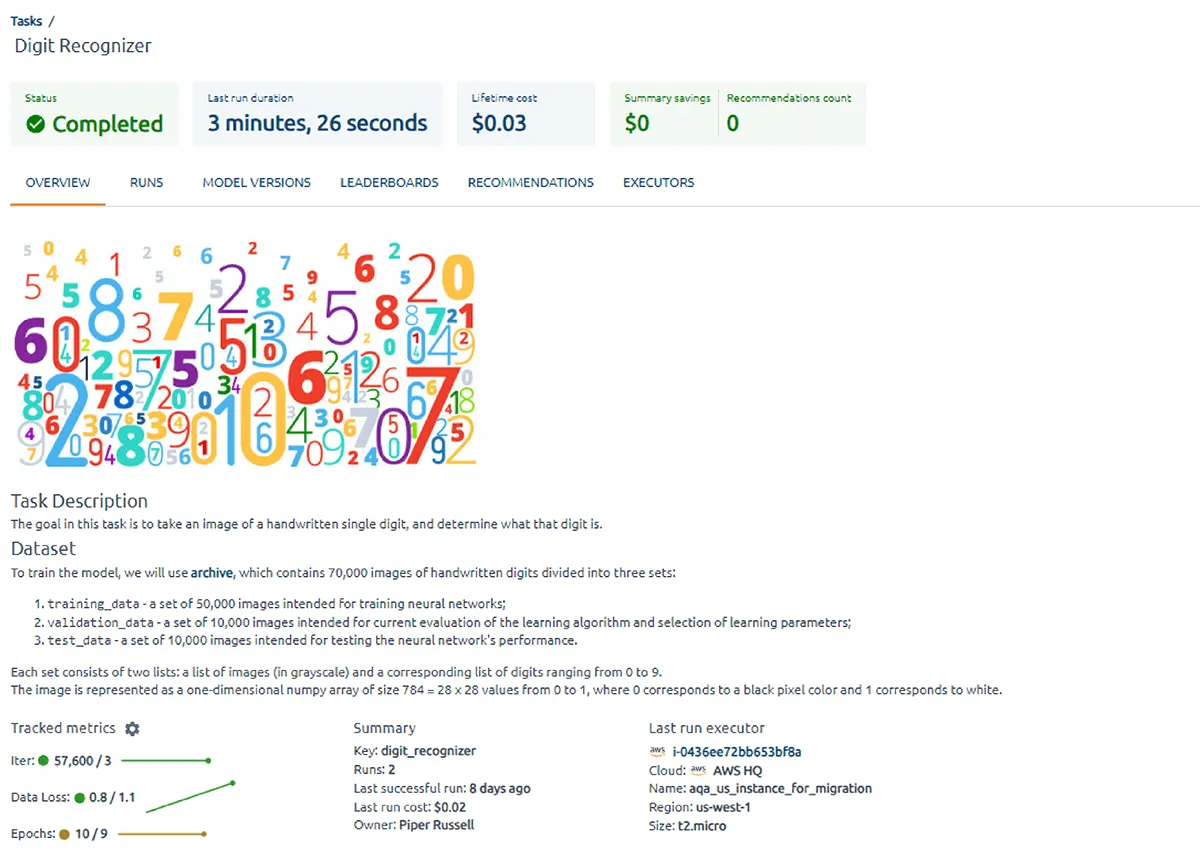

O rastreamento de modelos envolve registrar e gerenciar sistematicamente detalhes sobre modelos de aprendizado de máquina ao longo de seu ciclo de vida. O OptScale fornece aos usuários uma análise aprofundada de métricas de desempenho para qualquer chamada de API para serviços PaaS ou SaaS externos. O rastreamento de métricas, incluindo CPU, GPU, RAM, tempo de inferência e visualização com várias tabelas e gráficos, ajuda a melhorar o desempenho e otimizar custos de infraestrutura.

O OptScale Leaderboards oferece às equipes de ML total transparência em todas as métricas do modelo de ML, ajuda a comparar grupos de tarefas executadas de ML entre si com base em seu desempenho e encontra as combinações ideais.

O OptScale cria perfis de modelos de machine learning e analisa profundamente métricas internas e externas para qualquer chamada de API para serviços PaaS ou SaaS externos. A plataforma monitora constantemente os parâmetros de custo, desempenho e saída para melhor visibilidade de ML. A transparência completa ajuda a identificar gargalos e ajustar os parâmetros do algoritmo para maximizar a utilização de recursos de treinamento de ML/IA e o resultado dos experimentos.

Uma descrição completa do OptScale como uma plataforma de código aberto MLOps.

Melhore o processo de ML na sua empresa com Recursos de OptScale, incluindo

Descubra como:

Distribuído por

1250 Borregas Ave, Sunnyvale, CA 94089, EUA | [email protected]